Die 8. Pro²Future PartnerKonferenz liegt nun hinter uns, und sie war ein besonders bedeutsames Ereignis, da sie sich auf die Zukunft des Zentrums konzentrierte.

In diesem Jahr hatten wir die Ehre, mehr als 70 Teilnehmer von führenden Industrieunternehmen und akademischen Institutionen zu begrüßen, sowohl aus Österreich als auch aus dem Ausland, wie der Technischen Universität München, der Universität Leoben, der Johannes Kepler Universität Linz, der Technischen Universität Graz, AVL, Fronius, ANTEMO, Four Panels, WK STMK, RoboCup, Voestalpine, Platform Industrie 4.0, Siemens, Böhler, Land Steiermark, Primetals, SFG, UAR, DIH Süd, EWW, Land OÖ, DewineLabs, Silicon Alps…

Um die Konferenz zu eröffnen, hielt Univ.-Prof. Dr. Alois Ferscha einen Vortrag mit dem Titel “Pro²Future Epoch II”, in dem er auf die Position des Zentrums und seine Vision für die kommenden Jahre einging. Anschließend teilten unsere derzeitigen Bereichsleiter Einblicke in das, was wir in Zukunft von ihren jeweiligen Bereichen erwarten können.

Kurz vor der ersten Pause hatten wir das Privileg, einen Vortrag mit dem Titel “Zusammenleben, Zusammenarbeit und Ergänzung von Menschen und Robotern in den Fabriken der Zukunft” von Prof. Dr. Achim Lilienthal, Professor für Wahrnehmung für intelligente Systeme an der TU München, zu hören.

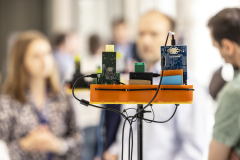

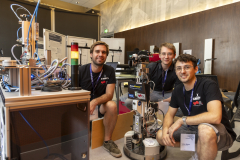

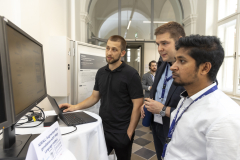

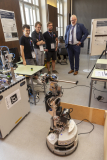

Nach der Pause gab unser CEO, DI Gerd Hribernig, einen Überblick über das Zentrum, seinen Fortschritt, seine Erfolge und zukünftigen Pläne. Während der Konferenz präsentierten wir 13 Demonstratoren, begleitet von 13 Postern, die unsere neuesten Forschungsergebnisse und unser unerschütterliches Engagement für die Unterstützung unserer industriellen Partner bei der Verbesserung ihrer industriellen Umgebung hervorhoben.

Die Liste der Demonstratoren mit ihren kurzen Beschreibungen finden Sie unten.

Area 1 Perception and Aware Systems

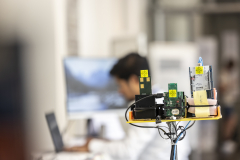

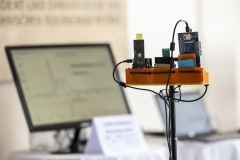

Fabrikweite Luftqualitätsmessung: Dieses System verwendet KI-basierte Technologie, um die Arbeitssicherheit in einer groß angelegten Polymerproduktionsumgebung zu verbessern. Eingebettete Systeme überwachen die Luftqualität und geben Echtzeitwarnungen an die Arbeiter aus, wenn Gefahren auftreten. Die Daten werden zur sofortigen Überwachung und Analyse in die Cloud übertragen.

Studie zur Interaktion zwischen Mensch und Drohne: Drohnen, die als KI-betriebene Cobots dienen, basieren auf angenehmen Interaktionen. Sie verwenden Blickkontakt als Bestätigung und nähern sich Benutzern erst nach Herstellung des Blickkontakts an. Ein Bodenfahrzeug empfängt und überwacht den Videofeed der Drohne mithilfe von tiefen neuronalen Netzen, um Interaktionen zu verfolgen.

Area 2 Cognitive Robotics and Shop Floors

Kognitive Unterstützung im Engineering-Prozess: Dieser kollaborative Engineering-Ansatz unterstützt Ingenieure und Prozessmodellierer, indem er die Rückverfolgbarkeit und Navigation von Artefakten verbessert, feinere Artefakteigenschaften in der Prozessmodellierung ermöglicht, zeitliche Prozessbeschränkungen berücksichtigt, Echtzeitprozessabweichungen erkennt und korrigiert sowie maßgeschneiderte Echtzeitprozessanleitungen für Ingenieure bereitstellt.

Flexible Mensch-Roboter-Kollaboration: In diesem Anwendungsfall setzen wir die Zusammenarbeit von Mensch und Maschine für flexible Fertigungssysteme neu ein. Wir verbessern die Umgebungswahrnehmung von Robotern mit verschiedenen Sensorsignalen und ML-Modellen und verfolgen gleichzeitig den Montageprozess, um die Synchronisation von Mensch-Roboter-Kollaborationen zu gewährleisten und die Flexibilität für menschliche Arbeitskräfte zu fördern.

Area 3 Cognitive Decision Making

MANDALA: Multivariate Anomalieerkennung und Exploration: MANDALA ist eine Plattform zur Identifizierung und Analyse von Anomalien in multivariaten Zeitreihendaten. Sie ermöglicht eine einfache Erkundung und Bewertung von Anomaliekandidaten, Dimensionen und zeitlichen Aspekten in komplexen Daten. Mit einer benutzerfreundlichen Oberfläche vereinfacht MANDALA die Verarbeitung großer, hochdimensionaler Sensorsignaldaten.

Visuelle Analyse für Produktionssysteme: Dieses Projekt bietet eine interaktive Visualisierung von Produktionsparametern, bei der Defekte nach Typ farbcodiert sind. Das Dashboard bietet eine Übersicht mit Zoom-Funktionen für eine detaillierte Analyse, um potenzielle Defektursachen innerhalb der Produktionsparameter zu identifizieren. Filter ermöglichen spezifische Datenanalysen, während anpassbare Tooltipps und ein Heatmap zusätzliche Informationen und lokale Parameterfluktuationen anzeigen.

AERIALL: Erweiterte Textgenerierung mit großen Sprachmodellen: AERIALL ist eine webbasierte Anwendung, die ein lokal gehostetes, vortrainiertes großes Sprachmodell verwendet. Sie ermöglicht das Hochladen von domainspezifischen Dokumenten, um die Wissensbasis des Modells zu erweitern und präzise Antworten auf maßgeschneiderte Fragen in verschiedenen Domänen zu liefern. Die Plattform legt Wert auf Sicherheit und Datenschutz.

VEEDASZ: Visual Exploration of Engineering Data with Analytical Semantic Zoom: Mit VEEDASZ können Fachexperten mehrere Zeitreihen in einer Kartenansicht erkunden. Es abstrahiert Daten auf einer niedrigen Zoomstufe und stellt wesentliche Attribute bereit, während beim Vergrößern detaillierte Zeitreihen sichtbar werden. Darüber hinaus bietet es eine leistungsstarke Linsenfunktion zum Gruppieren und Visualisieren von Datenähnlichkeiten und -unterschieden.

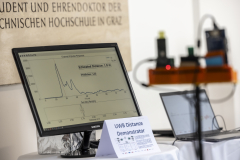

Area 4.1 Cognitive Products

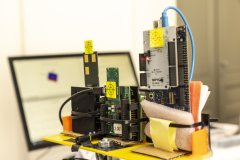

UWB-Distanzdemonstrator: Der Ultra-WideBand (UWB) Demonstrator hebt die drahtlose Indoor-Entfernungsmessung mit robuster UWB-Technologie hervor und gewährleistet Genauigkeit in jeder Umgebung. Mit drei UWB-Modulen sammelt er Echtzeitdaten über WLAN zur Live-Anzeige und zeigt präzise Messungen sowohl in der Sichtlinie (LoS) als auch außerhalb der Sichtlinie (NLoS) an. Darüber hinaus hat unsere Forschung im Bereich TinyAI ML-Modelle und Methoden identifiziert, um Herausforderungen bei NLOS anzugehen.

Kognitives Überwachungssystem: Die CORVETTE-Anwendungen sind für die gleichzeitige Überwachung verschiedener Fahrzeugparameter auf einem einzigen, robusten In-Fahrzeug-Kanten-Gerät konzipiert. Das Cognitive Monitoring System enthält Algorithmen für die Erkennung von Wetter und Tunneln, die Erkennung von Objekten und Fahrzeugen mit Verkehrsdichteschätzungen, die Echtzeit-Erkennung von Ziffern zur Geschwindigkeits- und Gangidentifikation sowie die Erkennung von Anomalien in Fahrzeugbewegungen. Im Rahmen von AVL-Fahrzeugtests vorgeführt, zeigt es die praktische Anwendbarkeit in realen Szenarien.

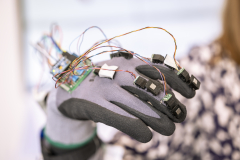

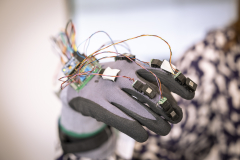

Handgesten-Demonstrator: Der Handgesten-Demonstrator erstellt ein digitales Abbild der Hand für Anwendungen wie Handverfolgung, Aktionserkennung und die Fernsteuerung von Maschinen. Ausgestattet mit kostengünstigen Sensoren liefert er genaue Daten, einschließlich Handpositionierung mittels UWB-Technologie, Fingerbewegungen und Interaktionen mit Objekten. Dieser Demonstrator zeigt unsere Forschung in TinyAI, maschinellem Lernen (ML) und fortschrittlicher UWB-Technologie.

Area 4.2 Cognitive Production Systems

Axiale Drehmomentmessung: Wir haben einen innovativen Ansatz zur Steuerung und Bestimmung des Energiebedarfs bei der Polymerverarbeitung entwickelt und erfolgreich einen Proof of Concept für die Laserablenkmethode umgesetzt. Dies umfasste die Anbringung mehrerer Spiegel an das Gehäuse, um eine axiale Deformationsmessung mit einer Auflösung von bis zu mehreren Mikroradianten zu ermöglichen. Beachtenswert ist, dass diese Ergebnisse als Patent Nr. 20-P-009 AT eingetragen sind.

P2D2: Leistungsverarbeitung zur Fehlererkennung: Die End-of-Line-Prüfung ist eine gängige Qualitätskontrollmethode, kann jedoch zu Demontage und Nacharbeiten führen. Im Gegensatz dazu erkennt P2D2 Defekte während der Teilefertigung durch Analyse der Bearbeitungsdaten und eliminiert so die Notwendigkeit zusätzlicher Sensoren. Dies bietet einen Vorteil bei der Fehlererkennung und -quantifizierung während der Teileproduktion.

Photos: Lunghammer